일론 머스크가 설립한 인공지능 연구소 xAI에서 개발한 챗봇 ‘그록(Grok)’은 흥미로운 가능성과 함께 다양한 논란을 불러일으키고 있습니다.

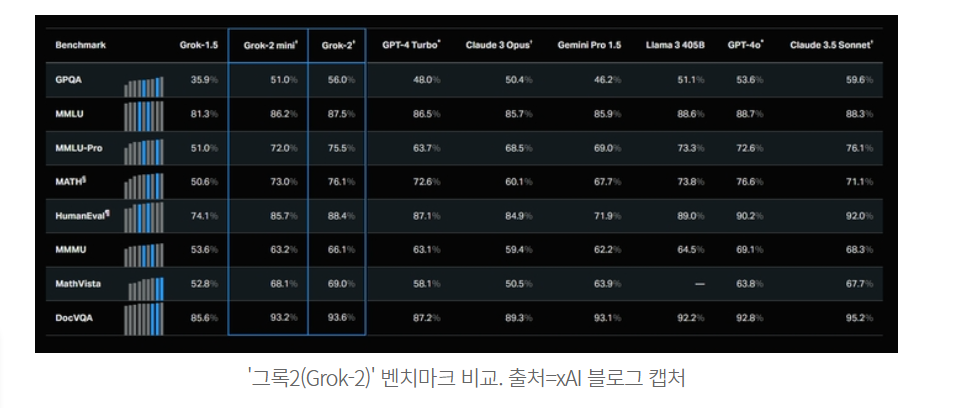

일론 머스크의 xAI가 개발 중인 AI 챗봇 ‘그록’은 진실 추구와 우주의 이해를 목표로 하는 혁신적인 프로젝트입니다. 뛰어난 성능과 함께 안전성, 편향성, 윤리적 문제 해결에 중점을 두고 있습니다. 그록은 인공지능 챗봇 기술의 미래를 엿볼 수 있는 중요한 발걸음입니다.

그록의 특징과 논란

- 재미를 추구하는 AI: 그록은 단순한 정보 제공을 넘어 사용자와의 재미있는 대화를 목표로 개발되었습니다. 유머, 창의적인 글쓰기 등 다양한 분야에서 뛰어난 성능을 보여주지만, 동시에 폭력적이고 선정적인 이미지를 생성하는 등 윤리적인 문제를 야기하기도 합니다.

- 제한 없는 자유도: 그록은 다른 AI 모델에 비해 상대적으로 제한적인 규제를 가지고 있습니다. 이는 창의적인 결과물을 도출하는 데 기여하지만, 동시에 허위 정보 확산, 혐오 발언 등 부작용을 초래할 수 있습니다.

- 사용자의 책임: 그록의 개발사인 xAI는 사용자가 생성된 콘텐츠에 대한 책임을 지도록 강조하고 있습니다. 즉, 사용자가 그록을 어떻게 활용하느냐에 따라 결과물의 성격이 달라진다는 것입니다.

그록이 제기하는 문제점

- 허위 정보 확산: 그록은 사실과 허구를 구분하지 못하고 그럴듯한 거짓 정보를 생성할 수 있습니다.

- 혐오 발언 생성: 폭력적이고 차별적인 내용을 포함한 텍스트나 이미지를 생성할 수 있습니다.

- 개인정보 유출: 사용자의 개인정보가 유출될 가능성이 있습니다.

- AI 오용: 그록이 악의적인 목적으로 사용될 수 있습니다.

그록의 미래와 과제

그록은 AI 기술의 발전 가능성을 보여주는 동시에, AI 개발과 활용에 있어 윤리적인 문제를 제기합니다. 앞으로 그록과 같은 AI 모델이 더욱 발전하기 위해서는 다음과 같은 과제를 해결해야 합니다.

- AI 안전성 확보: AI가 생성하는 콘텐츠의 안전성을 확보하기 위한 기술 개발이 필요합니다.

- 윤리적 가이드라인 마련: AI 개발 및 활용에 대한 명확한 윤리적 가이드라인을 마련해야 합니다.

- 사회적 합의 도출: AI 기술 발전에 따른 사회적 변화에 대한 논의와 합의가 필요합니다.

결론

그록은 AI 기술의 발전 가능성과 함께 AI가 가져올 수 있는 위험성을 동시에 보여주는 사례입니다. 우리는 그록과 같은 AI 기술을 어떻게 개발하고 활용할 것인지에 대해 신중하게 고민해야 합니다.

더 궁금한 점이 있으시면 언제든지 질문해주세요.

- 예시: 그록과 유사한 다른 AI 모델은 무엇이 있나요?

- 예시: AI의 윤리적 문제를 해결하기 위한 방안은 무엇이 있을까요?

관련 키워드: 그록, xAI, 일론 머스크, AI, 챗봇, AI 윤리, AI 안전성

참고 자료:

- 뉴스 기사: 그록 관련 뉴스 기사를 검색하여 더 자세한 정보를 얻을 수 있습니다.

- 전문가 의견: AI 전문가들의 의견을 참고하여 그록에 대한 다양한 시각을 이해할 수 있습니다.

- 연구 논문: AI 윤리, AI 안전성 등 관련 연구 논문을 통해 심층적인 정보를 얻을 수 있습니다.